Firma Meta twierdzi, że przejście na model „Notatek społeczności” działa, sądząc po najnowszej aktualizacji raportu dotyczącego przestrzegania standardów społeczności, w którym przedstawiono dane o wysiłkach spółki w zakresie moderacji treści oraz walki ze szkodliwymi elementami w jej aplikacjach.

Jak zapewne pamiętasz, w styczniu Meta ogłosiła przejście na model „Community Notes”, idąc śladem X, a także zakończenie procesu fact-checkingu realizowanego przez zewnętrzne organizacje. Według dyrektora generalnego Meta Marka Zuckerberga, firma doszła do punktu, w którym cenzura stała się nadmierna, dlatego chciała dać użytkownikom większe możliwości samodzielnego podejmowania decyzji dotyczących treści zamiast wprowadzania twardych decyzji odgórnie.

Fakt, że takie podejście pokrywa się z preferencjami prezydenta USA Donalda Trumpa, jest czystym przypadkiem i w żaden sposób nie jest powiązany ze strategią Meta w tej kwestii.

Więc jak Meta ocenia sukces swojej inicjatywy Community Notes w USA?

Zgodnie z danymi Meta:

«Z setek miliardów jednostek treści stworzonych na Facebooku i Instagramie w trzecim kwartale na całym świecie, mniej niż 1% zostało usunięte za naruszenie naszych zasad, a mniej niż 0,1% usunięto błędnie. Jeśli chodzi o usuniętą treść, dokładność naszych działań – czyli odsetek prawidłowych usunięć wśród wszystkich usunięć – wyniosła ponad 90% na Facebooku i ponad 87% na Instagramie».

Według Meta liczba błędów spadła, a zatem mniej osób skarży się na nieprawidłowe usunięcie ich postów przez automatyczny system Meta.

W ocenie Meta to zwycięstwo, ale jednocześnie jeśli ogólnie usuwasz znacznie mniej treści, to oczywiście błędów też będzie mniej.

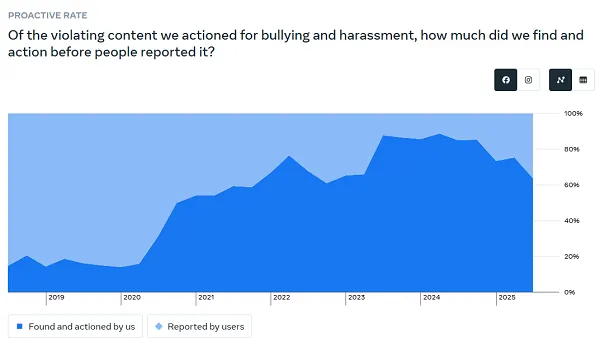

To znajduje odzwierciedlenie w danych. Na przykład w raporcie dotyczącym kategorii „Nękanie i zastraszanie” (bullying i harassment) zaznaczono, że w ciągu ostatnich trzech kwartałów znacząco spadł udział przypadków wykrywanych proaktywnie przez systemy Meta w porównaniu z naruszeniami zgłaszanymi przez użytkowników.

📈 Proaktywne wykrywanie nękania i bullyingu

Wykres pokazuje, jaką część naruszających treści (dotyczących nękania i prześladowania) platforma znalazła i zablokowała samodzielnie, zanim użytkownicy zdążyli złożyć skargę.

- Po poziomej osi czasu – lata 2019-2025.

- Po pionowej osi – procent naruszeń, wobec których działania podjęto proaktywnie.

🔵 Ciemna część obszaru – „Found and actioned by us”: treści, które system i moderatorzy wykryli sami.

🔵 Jasna górna część – „Reported by users”: to, co wykryto dopiero po zgłoszeniach.

📊 Dynamika:

- W 2019 poziom proaktywności był niski (około 20-30%).

- W 2020-2021 następuje gwałtowny wzrost, wskaźnik przekracza ok. 60-70%.

- W 2023-2024 osiąga maksimum (prawie 90%) – większość treści z nękaniem platforma wykrywa sama.

- W 2025 wskaźnik nieco spada, ale wciąż pozostaje wysoki – na poziomie ok. 70+%.

💡 Sens: z czasem platforma coraz lepiej automatycznie znajduje treści związane z bullyingiem i prześladowaniem i coraz mniej polega wyłącznie na zgłoszeniach użytkowników.

Proaktywne wykrywanie naruszeń i działania ze strony Meta w tym obszarze spadły o 20%, co oznacza, że coraz więcej użytkowników widzi treści naruszające zasady.

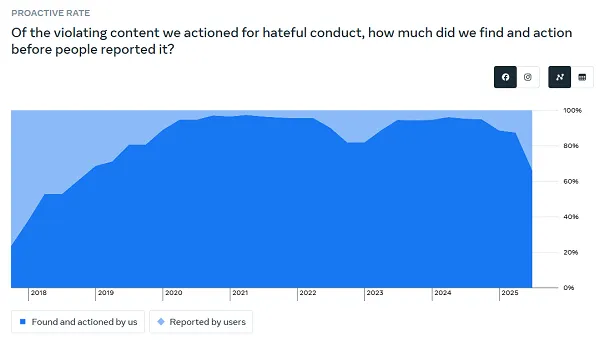

To samo odzwierciedla wykres „Hateful Conduct” (mowy nienawiści):

📈 Proaktywne wykrywanie treści z przejawami nienawiści

Na wykresie pokazano, jaką część naruszających treści z kategorii hateful conduct platforma znajduje i usuwa samodzielnie, zanim pojawią się skargi użytkowników.

- Na osi X – lata 2018-2025.

- Na osi Y – odsetek naruszeń, wobec których działania podjęto proaktywnie (w procentach).

🔵 Ciemna część obszaru – Found and actioned by us

Treści z przejawami nienawiści, które wykryły algorytmy i moderatorzy bez zgłoszeń.

🔵 Jasna górna „warstwa” – Reported by users

Naruszenia wykryte dopiero po zgłoszeniach użytkowników.

📊 Co widać z dynamiki:

- W 2018 proaktywność była zauważalnie niższa (około połowy wszystkich przypadków).

- W 2019-2021 platforma gwałtownie poprawiła automatyczne wykrywanie: wskaźnik proaktywności rośnie do 90-95%.

- W 2022 pojawia się niewielki spadek, ale poziom wciąż jest bardzo wysoki.

- W 2023-2024 utrzymuje się niemal na maksimum.

- W 2025 udział proaktywnie wykrytych treści spada, ale nadal pozostaje w okolicach 80+%.

💡 Sedyment: w ostatnich latach platforma nauczyła się wychwytywać zdecydowaną większość treści z nienawiścią sama, zanim zareagują użytkownicy, choć w 2025 roku wskaźnik ten jest niższy niż w latach szczytowych.

Ostatni spadek na wykresie świadczy o zauważalnym ograniczeniu działań prewencyjnych w problematycznym obszarze, który od dawna jest znany z masowego rozpowszechniania w mediach społecznościowych.

W rezultacie, chociaż Meta może popełniać mniej błędów związanych z nadmiernym egzekwowaniem zasad i niesłusznym karaniem użytkowników, co wpisuje się w „bardziej wolnościowe” podejście, do którego dążą Zuckerberg i jego zespół, to jednocześnie więcej osób w jej aplikacjach styka się z potencjalnie szkodliwymi treściami. Sądząc po pokazanych wyżej spadkach, systemy Meta mogłyby te treści wykryć i usunąć, ale firma woli przepuszczać więcej materiałów i przedstawia to jako pozytyw, ponieważ użytkownicy są mniej ograniczani.

W gruncie rzeczy, choć Meta twierdzi, że „dokładność kontroli” wyniosła 90%, trudno ilościowo ocenić sukces Community Notes jako alternatywy dla systematycznej kontroli, jeśli jedynym twardym kryterium jest to, czy użytkownicy składają skargi, czy nie. Twórcom, którzy nadal stawiają na żywy tekst w feedzie i chcą wzmacniać każdy wpis przemyślanymi podpisami, przyda się szczegółowy poradnik Jak podpisać zdjęcie w Instagramie?.

Jeśli chodzi o konkretne obszary polityki, Meta twierdzi:

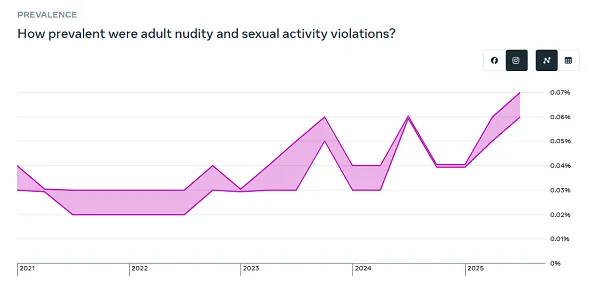

«Zarówno na Facebooku, jak i na Instagramie wzrosła częstość występowania treści z nagością dorosłych i aktywnością seksualną, a także treści brutalnych i drastycznych, a na Facebooku – rozpowszechnienie treści związanych z nękaniem i prześladowaniem. W dużej mierze wiąże się to ze zmianami wprowadzonymi w ciągu kwartału w celu poprawy szkolenia moderatorów i usprawnienia procesów weryfikacji, co wpływa na sposób znakowania próbek przy pomiarze rozpowszechnienia».

📈 Jak często łamane są zasady dotyczące nagości i aktywności seksualnej

Wykres pokazuje udział naruszeń zasad dotyczących nagości dorosłych i seksualnych treści za okres 2021-2025.

- W 2021 poziom naruszeń zaczyna się wyżej, potem nieco spada i utrzymuje się względnie nisko.

- W 2022 wskaźnik pozostaje mniej więcej na podobnym, niskim poziomie, bliżej dolnej granicy wykresu.

- W 2023 zaczyna się wzrost: w połowie okresu krzywa wyraźnie idzie w górę, potem następuje chwilowy spadek i ponowny wzrost.

- W 2024 widać kolejny skok w górę, następnie częściowy spadek i stabilizację.

- W 2025 linia znów idzie do góry i pod koniec osiąga maksymalną wartość z całego okresu (nieco poniżej 0,07% całej obejrzanej treści).

💡 Wniosek: udział treści naruszających zasady dotyczące nagości dorosłych i aktywności seksualnej pozostaje bardzo niski w odsetku całkowitej liczby wyświetleń, ale od 2023 roku widoczny jest trend wzrostowy, którego szczyt przypada na 2025 rok.

Biorąc pod uwagę to zastrzeżenie, trudno jednoznacznie ocenić, czy jest to istotna zmiana, ponieważ Meta twierdzi, że wzrost wynika wyłącznie ze zmiany metodologii.

Być może te skoki są warte uwagi, być może rzeczywiście sygnalizują poprawę.

Jednak w świetle ostatnich prób zaostrzenia restrykcji w mediach społecznościowych dla nastolatków, ten wykres nadal budzi niepokój:

📈 Jak dużo treści o samobójstwie, samookaleczeniach i zaburzeniach odżywiania platforma usuwa

Na wykresie pokazano, wobec ilu materiałów dotyczących samobójstwa, samouszkodzeń i zaburzeń odżywiania platforma podjęła działania (usunięcie, ograniczenie, ostrzeżenie) w latach 2020-2025.

- W 2020 wolumeny są stosunkowo niewielkie, linia biegnie nisko.

- Pod koniec 2020 – na początku 2021 widać pierwszy wyraźny skok w górę.

- W 2021-2022 liczba treści, wobec których podjęto działania, rośnie gwałtownie i osiąga pierwszy szczyt.

- W 2023-2024 wartości pozostają wysokie, z falującymi wzrostami i spadkami, ale zdecydowanie powyżej poziomu z 2020 roku.

- W 2025 krzywa znów ostro pnie się w górę i osiąga około 10 mln przypadków – to najwyższa wartość w całym badanym okresie.

💡 Ważne: wykres nie pokazuje „ile takich treści istnieje w ogóle”, lecz w ilu przypadkach platforma faktycznie zareagowała. Wzrost może oznaczać zarówno wzmocnienie moderacji, jak i większą liczbę takich materiałów, albo jedno i drugie naraz. Dla twórców i SMM-owców dodatkowym sygnałem „zdrowia” odbiorców pozostają zapisy i zaangażowanie pod bezpiecznymi treściami – wygodnie śledzić to przy pomocy technik z opracowania Jak sprawdzić, kto zapisał zdjęcie w Instagramie.

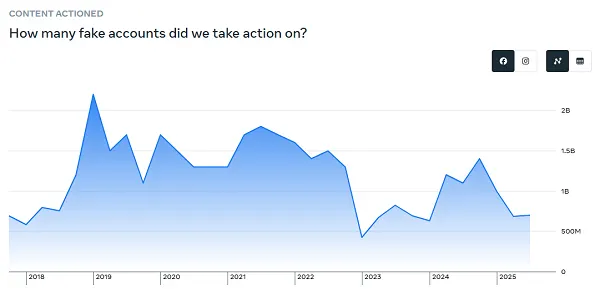

Jeśli chodzi o fałszywe konta, Meta twierdzi, że około 4% z ponad 3 miliardów aktywnych użytkowników miesięcznie to fejkowe profile.

📈 Ile fałszywych kont platforma blokuje

Wykres pokazuje, wobec ilu fałszywych kont podjęto działania w latach 2018-2025 (usunięcie, wyłączenie itp.).

- W 2018 poziom jest względnie niski, ale pod koniec roku zaczyna się gwałtowny wzrost.

- W 2019 krzywa skacze do prawie 2 mld kont – to szczytowy poziom w całym badanym okresie.

- W 2020-2021 wartości utrzymują się wysoko, ale stopniowo spadają, choć nadal liczone są w miliardach.

- Pod koniec 2022 widoczny jest głęboki spadek prawie do minimalnych wartości.

- W 2023-2024 znów obserwujemy falujący wzrost: najpierw skok w górę, potem spadek i kolejny wyraźny pik.

- W 2025 liczba zablokowanych fejków maleje i utrzymuje się mniej więcej na poziomie ok. 1 mld kont.

💡 Wniosek: platforma co roku usuwa ogromne ilości fałszywych kont, przy czym najbardziej „agresywny” okres walki z nimi przypadł na 2019 rok. Później widać ogólny trend spadkowy, ale liczby nadal są ogromne.

Wielu użytkowników zadaje sobie pytanie o skalę tego zjawiska, opierając się na własnych doświadczeniach z fejkowymi profilami na Facebooku i Instagramie. Choć dziś coraz trudniej odróżnić fałszywy profil od sztucznej inteligencji – i czy w ogóle powinniśmy traktować to jako to samo zjawisko? Na przykład Meta pracuje nad projektem dodania botów z AI do swoich aplikacji, które będą „zachowywać się” jak prawdziwi ludzie. Czy one są fejkami?

Tak czy inaczej, dla porównania: 4% z łącznej liczby 3,54 mld użytkowników to nadal ponad 140 mln fałszywych profili w aplikacjach Meta, co firma oficjalnie przyznaje.

Tak to wygląda w liczbach.

Meta opublikowała także zaktualizowaną wersję raportu „Widely Viewed Content”, który daje bardziej szczegółowy obraz tego, co ludzie faktycznie widzą na Facebooku w USA.

Raport po raz pierwszy opublikowano w 2021 roku, aby obalić przekonanie, że algorytmy Facebooka promują treści siejące podziały i dezinformację. Pokazując, jakie typy postów i stron faktycznie generują najwięcej reakcji, Meta stara się podkreślić, że problem nie jest tak duży, jak mogłoby się wydawać. Choć znów – należy zauważyć, że w skali Meta nawet treści z „relatywnie niskim” zaangażowaniem mogą docierać do milionów ludzi. Przy pracy z reakcjami w ekosystemie Meta warto patrzeć nie tylko na zasięgi, ale także na to, kto konkretnie wchodzi w interakcję z postami, co szczegółowo wyjaśnia materiał Jak sprawdzić, kto polubił post w Instagramie.

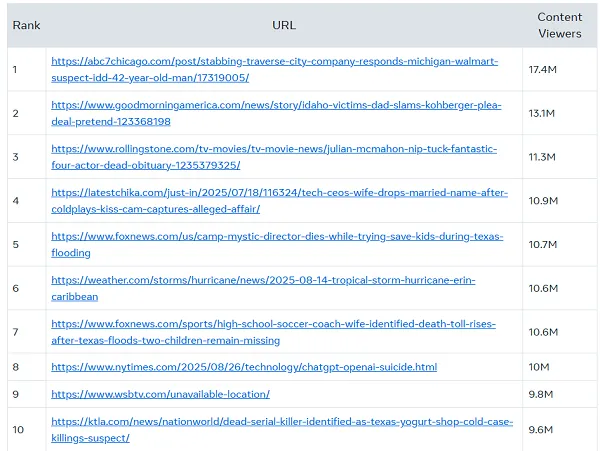

Jeśli chodzi o zasięgi, Meta raportuje, że największe zainteresowanie na Facebooku budzą głównie najpopularniejsze wiadomości.

Historie kryminalne, śmierć aktora Juliana McMahona, para na koncercie Coldplay – to typy newsów, które zdobyły najwięcej reakcji na Facebooku w trzecim kwartale.

A więc nie politycznie zapalne materiały, lecz angażujące historie o realnych wydarzeniach. To w gruncie rzeczy lepsze niż standardowy zestaw treści, które zwykle dominują w tego typu rankingach (często wygrywają plotki z tabloidów), ale główne przesłanie Facebooka jest takie, że treści polityczne nie stanowią głównego tematu dyskusji w aplikacji.

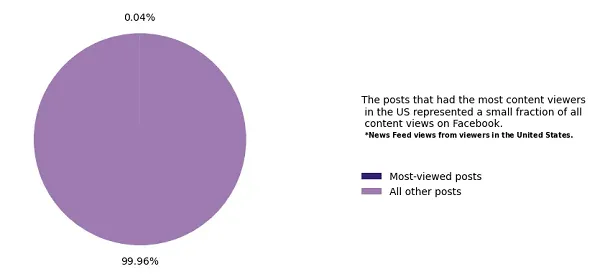

Ogólnie jednak warto zauważyć, że udział uwagi skupionej na najbardziej popularnych postach jest śladowy w skali całego Facebooka.

📊 Superwirusowe posty na Facebooku – mikrokropla w oceanie treści

Na wykresie kołowym pokazano, jaką część wszystkich wyświetleń feedu w USA generują „najczęściej oglądane” posty.

- 🔹 Najczęściej oglądane posty – zaledwie 0,04 %

- 🔸 Cała reszta postów – ogromne 99,96 %

✨ Wniosek: nawet wpisy, które zebrały najwięcej wyświetleń w USA, stanowią tylko maleńki ułamek wszystkich odsłon treści na Facebooku. Zdecydowana większość uwagi rozkłada się na miliony zwykłych postów.

W szerszym ujęciu skala i zasięg platformy są tak ogromne, że każde wzmocnienie ma znaczenie, dlatego nawet przy tych zastrzeżeniach dotyczących topowych postów nie otrzymujemy pełnego obrazu całkowitego wpływu Facebooka.

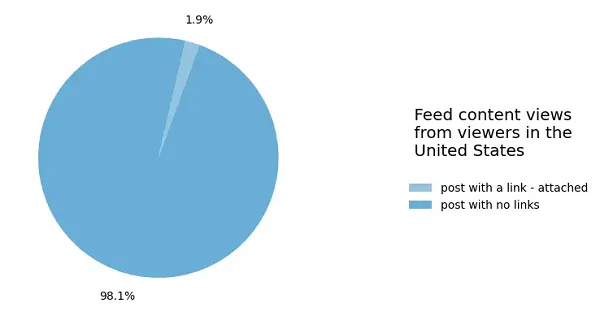

Jest jeszcze wykres, którego specjaliści od marketingu cyfrowego szczególnie nie lubią:

📊 Jakie posty najczęściej ogląda się w feedzie Facebooka (USA)

Diagram pokazuje, które posty generują wyświetlenia w głównym feedzie użytkowników z USA:

- 🔹 Posty bez linków – aż 98,1 % wszystkich odsłon.

- 🔗 Posty z dołączonym linkiem – tylko 1,9 % wyświetleń.

✨ Wniosek: prawie wszystkie wyświetlenia feedu przypadają na zwykłe posty bez linków zewnętrznych. Treści „bez kliku na zewnątrz” wyraźnie dominują.

Publikacje z linkami stanowią znikomy udział całej konsumpcji treści na Facebooku, więc jeśli chcesz generować ruch na strony, czeka cię najpewniej rozczarowanie. Tym, którzy i tak budują część ruchu wokół materiałów wizualnych i wrzucają je nie tylko z telefonu, ale też z laptopa, pomaga instrukcja krok po kroku Jak zrobić nowy post w Instagramie z komputera.

Udział postów z linkami spadł w porównaniu z pierwszym kwartałem, kiedy wynosił 2,7%, podczas gdy w 2022 roku było to 9,8%.

Widać więc wyraźny spadek liczby publikacji z linkami w aplikacji.

Ogólnie rzecz biorąc, w najnowszych raportach Meta o transparentności nie ma szczególnie przełomowych wniosków. Wysiłki na rzecz rozwoju moderacji prowadzą do spadku liczby błędów, ale potencjalnie zwiększają ryzyko szkód. Choć według wskaźników Meta także w tym obszarze widać poprawę. Dopóki Meta balansuje między moderacją a swobodą, twórcy często dostosowują swoją strategię do zachowań odbiorców jednocześnie na kilku platformach, a w szukaniu tematów na treści bardzo pomaga praktyczny poradnik Jak sprawdzić popularne zapytania na YouTube.